Navigieren Sie den EU AI Act – Bleiben Sie der KI einen Schritt voraus

Klarheit gewinnen, Compliance sichern und Regulierung in einen Wettbewerbsvorteil verwandeln.

Das neue Zeitalter von KI Governance verstehen

Der EU AI Act definiert neu, wie Organisationen künstliche Intelligenz einsetzen, indem er einen klaren Rahmen schafft, der Innovation mit ethischen und regulatorischen Standards vereint. Durch das Verständnis dieser Richtlinien können Unternehmen das Potenzial von KI ausschöpfen und gleichzeitig die Einhaltung sich entwickelnder Vorschriften sicherstellen.

„Der EU AI Act ist kein Hindernis, sondern Ihr Navigationssystem. Entwickeln Sie jetzt vertrauensbasierte KI, um schneller und sicherer zu skalieren.“

Wer ist betroffen?

Der EU AI Act gilt für jede Organisation – unabhängig von Standort oder Größe –, die KI-Systeme in der EU anbietet, einsetzt oder importiert oder deren KI-Systeme Auswirkungen auf Personen innerhalb der EU haben. Ausnahmen bestehen für bestimmte Anwendungen mit minimalem Risiko sowie für freie/Open-Source-Software, sofern keine systemischen Risiken vorliegen.

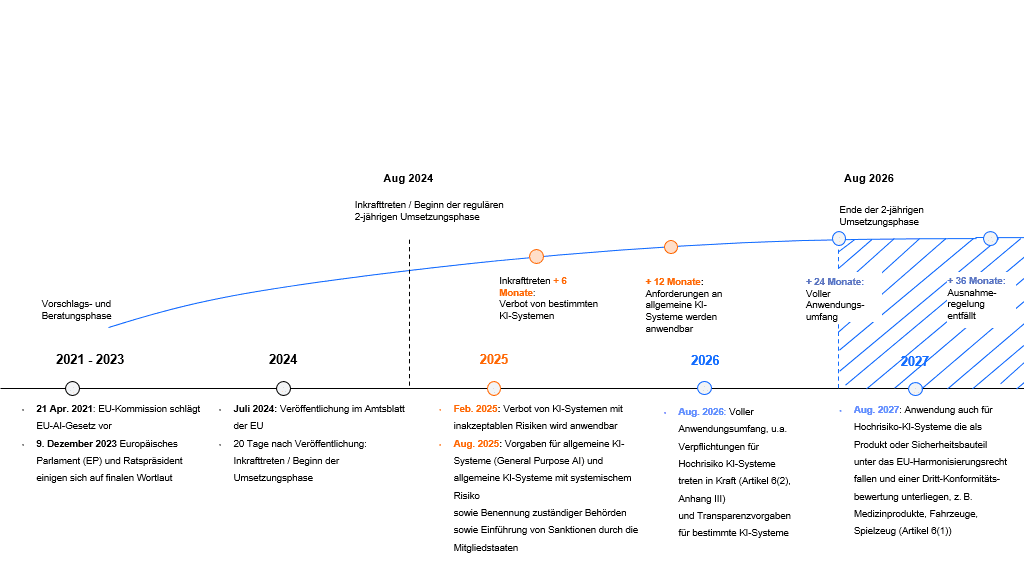

Wann tritt er in Kraft?

- Aug. 2024: Inkrafttreten

- Aug. 2026: Der Großteil des EU AI Act wird 24 Monate nach Veröffentlichung anwendbar

Weitere spezifische Fristen:

- Feb. 2025: Verbot auf KI-Systeme der höchsten Risikokategorie

- Aug. 2025: Governance-Anforderungen und Pflichten für General Purpose AI wurden anwendbar

- Aug. 2027: Anwendung auf Systeme, die bereits durch EU-Recht reguliert sind (z. B. Medizinprodukte, industrielle Maschinen)

Der EU AI Act ist im August 2024 in Kraft getreten und wird in den nächsten 36 Monaten schrittweise anwendbar.

Was ist enthalten?

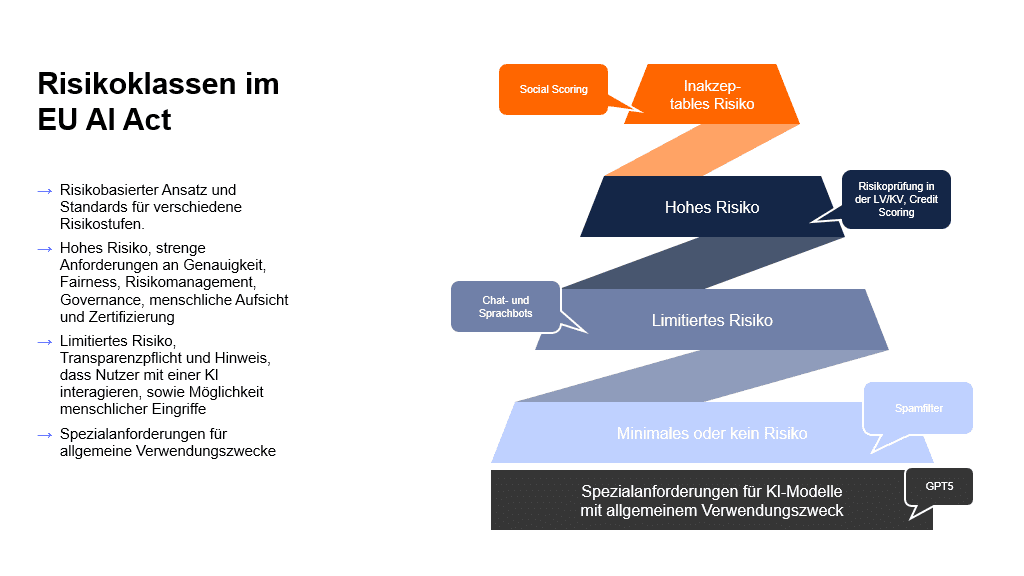

Ein risikobasierter Ansatz zur Einstufung von KI-Systemen in vier Risikokategorien sowie die Definition von Pflichten für Unternehmen je nach Einstufung.

Risikoklassen im EU AI Act auf einen Blick:

Governance und Durchsetzung

- Das EU AI Office koordiniert die EU-weite Anwendung des AI Acts, legt Verhaltenskodizes für GPAI (Global Partnership on Artificial Intelligence) fest und überwacht systemische Risiken.

- Nationale Behörden sind für die tägliche Durchsetzung zuständig (Audits, Korrekturmaßnahmen, Bußgelder), bearbeiten Beschwerden, ordnen Rücknahmen/Rückrufe an und betreiben regulatorische Sandboxes.

Sanktionsrahmen mit drei Kategorien:

- Verwendung verbotener KI

- Bis zu 35 Mio. € oder 7 % des weltweiten Jahresumsatzes (je nachdem, welcher Wert höher ist)

- Nichteinhaltung von Transparenz- und Datenanforderungen

- 15 Mio. € oder 3 % des weltweiten Jahresumsatzes

- Bereitstellung falscher Informationen

- 7,5 Mio. € oder 1,5 % des weltweiten Jahresumsatzes

Konformität und Standards für Hochrisiko-KI

- Eine Konformitätsbewertung ist erforderlich, bevor ein System auf den Markt gebracht wird. Wer harmonisierte Standards nutzt, gilt als konform; in bestimmten Fällen ist eine Prüfung durch eine benannte Stelle erforderlich.

- Anbieter müssen Hochrisiko-KI-Systeme vor der Markteinführung in der EU-Datenbank registrieren.

- Überwachung nach Markteinführung:

Anbieter führen eine kontinuierliche Überwachung durch und melden schwerwiegende Vorfälle. Anwender/Betreiber kooperieren und melden Probleme, die im Einsatz auftreten.

Nutzen Sie die Chance: Was der EU AI Act für Sie bedeutet

Der EU AI Act schafft einen robusten regulatorischen Rahmen, der KI-Systeme nach Risiko klassifiziert und klare Pflichten für Anbieter, Anwender und Entwickler von General-Purpose AI definiert.

Durch die Umsetzung der Anforderungen können Sie KI gewinnbringend nutzen und gleichzeitig sicherstellen, dass Sie Ihre Mitarbeitenden, Kund:innen und Partner vor möglichen negativen Auswirkungen schützen.

Wie wir Ihre KI-Reise unterstützen

Bei Eraneos verbinden wir tiefgehende Expertise mit einer bewährten Methodik. Unser pragmatischer Ansatz liefert risikoorientierte, auditfeste Lösungen, die in der Praxis wirklich funktionieren. Wir unterstützen Sie unter anderem in folgenden Bereichen:

- Unterstützung bei der Klassifizierung Ihrer KI-Systeme

- Abschätzung des Folgeaufwands je nach Klassifizierung und Erarbeitung von Entscheidungsoptionen

- Berücksichtigung der Anforderungen an Entwicklung und Nutzung bereits bei der Gestaltung der Use Cases

- Sicherstellung von KI-Kompetenz gemäß Artikel 4 (Grundlagenschulung)

- Regulatorisch konforme Dokumentation und Sicherstellung der Auditierbarkeit

- Verhaltenskodizes und Governance-Mechanismen (freiwillig für Nicht-Hochrisiko-KI) gemäß den EIOPA-Grundsätzen für KI-Governance

- Etablierung eines Freigabeprozesses für KI-Lösungen, bevor sie produktiv eingesetzt werden

Ein genauerer Blick auf die Risikokategorien

Let’s create sustainable change together.

Manuel Maier

Senior Manager

Jan-Philipp Krüger

Manager

Thorge Meinen

Senior Consultant